ПНСТ 843-2023

(ИСО/МЭК 38507:2022)

ПРЕДВАРИТЕЛЬНЫЙ НАЦИОНАЛЬНЫЙ СТАНДАРТ РОССИЙСКОЙ ФЕДЕРАЦИИ

Информационные технологии

СТРАТЕГИЧЕСКОЕ УПРАВЛЕНИЕ ИНФОРМАЦИОННЫМИ ТЕХНОЛОГИЯМИ

Последствия влияния стратегического управления при использовании искусственного интеллекта организациями

Information technology. Governance of information technology. Governance implications of the use of artificial intelligence by organizations

ОКС 35.020

Дата введения с 2024-01-01

до 2027-01-01

Предисловие

1 ПОДГОТОВЛЕН Научно-образовательным центром компетенций в области цифровой экономики Федерального государственного бюджетного образовательного учреждения высшего образования "Московский государственный университет имени М.В.Ломоносова" (МГУ имени М.В.Ломоносова) и Обществом с ограниченной ответственностью "Институт развития информационного общества" (ИРИО) на основе собственного перевода на русский язык англоязычной версии стандарта, указанного в пункте 4

2 ВНЕСЕН Техническим комитетом по стандартизации ТК 164 "Искусственный интеллект"

3 УТВЕРЖДЕН И ВВЕДЕН В ДЕЙСТВИЕ Приказом Федерального агентства по техническому регулированию и метрологии от 15 ноября 2023 г. N 58-пнст**

4 Настоящий стандарт является модифицированным по отношению к международному стандарту ИСО/МЭК 38507:2022* "Информационные технологии. Стратегическое управление информационными технологиями. Последствия влияния стратегического управления при использовании искусственного интеллекта организациями" (ISO/IEC 38507:2022 "Information technology - Governance of IT - Governance implications of the use of artificial intelligence by organizations", MOD) путем изменения отдельных фраз (слов, значений показателей, ссылок), а также путем внесения технических отклонений, объяснение которых приведено во введении к настоящему стандарту.

Сведения о соответствии ссылочных национальных стандартов международным стандартам, использованным в качестве ссылочных в примененном международном стандарте, приведены в дополнительном приложении ДА

Правила применения настоящего стандарта и проведения его мониторинга установлены в ГОСТ Р 1.16-2011 (разделы 5 и 6).

Федеральное агентство по техническому регулированию и метрологии собирает сведения о практическом применении настоящего стандарта. Данные сведения, а также замечания и предложения по содержанию стандарта можно направить не позднее чем за 4 мес до истечения срока его действия разработчику настоящего стандарта по адресу: 119991 Российская Федерация, Москва, Ленинские горы, д.1, и в Федеральное агентство по техническому регулированию и метрологии по адресу: 123112 Российская Федерация, Москва, Пресненская набережная, д.10, стр.2.

В случае отмены настоящего стандарта соответствующая информация будет опубликована в ежемесячном информационном указателе "Национальные стандарты", а также будет размещена на официальном сайте Федерального агентства по техническому регулированию и метрологии в сети Интернет (www.rst.gov.ru)

Введение

Целью настоящего стандарта является предоставление руководства для руководящего органа организации, которая использует или рассматривает возможность использования искусственного интеллекта (ИИ).

Настоящий стандарт содержит руководство по роли руководящего органа в отношении использования ИИ в своей организации и рекомендации по применению в организациях соответствующих стандартов в качестве основы для стратегического управления ИИ.

В настоящем стандарте рассмотрены природа и механизмы ИИ в той степени, которая необходима для понимания последствий их использования с точки зрения стратегического управления: какие дополнительные возможности, риски и ответственность, которые несет использование ИИ. Акцент делается на стратегическом управлении (которое осуществляется людьми) использованием ИИ в организации, а не на технологиях, составляющих любую систему ИИ, однако такое стратегическое управление требует понимания последствий использования технологий.

Искусственный интеллект

Искусственный интеллект включает семейство технологий, которые объединяют: вычислительную мощность, масштабируемость, сетевые технологии, подключенные устройства и интерфейсы, хранилища массивов данных, информационно-коммуникационную инфраструктуру, программное обеспечение (в том числе в котором использованы методы машинного обучения), процессы и сервисы по обработке данных и поиску решений, разработанные с целью извлечения знаний из набора данных, решения когнитивных задач, обычно предназначаемых для человеческого интеллекта, включая самообучение и поиск решений без заранее заданного алгоритма, решение задач и распознавание шаблонов и способность обучаться и совершенствоваться в ходе выполнения поставленных задач, а также значительные объемы данных. Упоминание ИИ в настоящем стандарте следует понимать как ссылку на целое семейство технологий и методов, а не на конкретные технологию, метод или приложение. Концепция и терминология ИИ представлены в [1].

Использование ИИ

Использование ИИ определено в настоящем стандарте в самом широком смысле как разработка или применение системы ИИ на любом этапе ее жизненного цикла для достижения целей и создания ценности для организации. Это включает взаимоотношения с любой из третьих сторон, предоставляющих или использующих такие системы.

Последствия влияния стратегического управления при использовании искусственного интеллекта

В настоящем стандарте рассмотрены последствия использования ИИ для организации. Применение ИИ, как и другого мощного инструмента, влечет за собой новые риски и ответственность, которые следует учитывать организациям, использующим его. ИИ не является по своей сути "добрым" или "злым", "справедливым" или "предвзятым", "этичным" или "неэтичным", хотя это может восприниматься таким образом.

Цель организации, этические нормы и другие руководящие принципы отражены официально или неофициально в ее политике. В настоящем стандарте рассмотрены как политика стратегического управления и политика организации, так и их применение, а также даются рекомендации по их адаптации для использования ИИ. Аспекты политики, связанные с оперативной деятельностью, реализуются посредством системы оперативного управления. Настоящий стандарт содержит ссылки на другие стандарты для получения подробной информации по смежным темам, включая социальную ответственность, надежность (например, менеджмент рисков, менеджмент предвзятости и качества) и менеджмент соответствия требованиям.

В настоящий стандарт включены дополнительные стандарты, выделенные курсивом*, а также внесены следующие изменения:

- изменен раздел "Введение";

- в разделе 2 удалена нормативная ссылка на [1] и добавлены нормативные ссылки на ГОСТ Р 70462.1-2022, ГОСТ Р ИСО 26000-2012, ГОСТ Р ИСО 31000-2019, ГОСТ Р ИСО/МЭК 38500-2017, ГОСТ Р ИСО/МЭК 38506;

- в разделе 3 удалено примечание о статусе [1] и приведена ссылка на [2];

- в 3.2.2 приведена ссылка на ГОСТ Р ИСО 31000-2019 (3.1);

- в 3.2.3 приведена ссылка на ГОСТ Р 51897-2021 (4.7.1.2);

- в 5.3 наименования рисунков 1, 2 изменены, а также удалены примечания о статусе [1];

- в 6.2 удалено примечание о статусе [3];

- 6.5 дополнен ссылкой на [4];

- в 6.7.2 изменен следующий абзац: "Кроме того, руководящему органу следует обеспечить, чтобы там, где это применимо, подрядчики и субподрядчики организации соблюдали те же кодексы практики и политики";

- в 6.7.4 удалено примечание о статусе [5], [6];

- раздел "Библиография" дополнен [1], [2], [4].

1 Область применения

Настоящий стандарт устанавливает руководство для членов руководящего органа организации по обеспечению и регулированию использования искусственного интеллекта (ИИ) с целью обеспечения его эффективного, действенного и приемлемого применения в организации.

Настоящий стандарт также является руководством для более широкого круга лиц, включая следующие категории:

- высшее руководство;

- внешние коммерческие организации и специалисты-профессионалы, такие как юристы и бухгалтеры; ассоциации розничной торговли, отраслевые ассоциации и профессиональные организации и ассоциации;

- представители органов государственной власти;

- внутренние и внешние поставщики услуг (включая консультантов);

- оценщики и аудиторы.

Настоящий стандарт распространяется на стратегическое управление использованием информационных технологий (ИТ) как в настоящем, так и в будущем, а также на результаты такого применения для организации.

Настоящий стандарт применим к любой организации, включая общественные и частные организации, государственные структуры и некоммерческие организации, а также к организациям любого размера, несмотря на их зависимость от данных или ИТ.

2 Нормативные ссылки

В настоящем стандарте использованы нормативные ссылки на следующие стандарты:

ГОСТ Р 58608-2019 Информационные технологии. Стратегическое управление ИТ. Структура и модель

ГОСТ Р 70462.1 Информационные технологии. Интеллект искусственный. Оценка робастности нейронных сетей. Часть 1. Обзор

ГОСТ Р ИСО 26000-2012 Руководство по социальной ответственности

ГОСТ Р ИСО 31000-2019 Менеджмент риска. Принципы и руководство

ГОСТ Р ИСО/МЭК 38500-2017 Информационные технологии. Стратегическое управление ИТ в организации

ГОСТ Р ИСО/МЭК 38506** Информационные технологии. Управление ИТ. Применение ИСО/МЭК 38500 для управления инвестициями в ИТ

Примечание - При пользовании настоящим стандартом целесообразно проверить действие ссылочных стандартов в информационной системе общего пользования - на официальном сайте Федерального агентства по техническому регулированию и метрологии в сети Интернет или по ежегодному информационному указателю "Национальные стандарты", который опубликован по состоянию на 1 января текущего года, и по выпускам ежемесячного информационного указателя "Национальные стандарты" за текущий год. Если заменен ссылочный стандарт, на который дана недатированная ссылка, то рекомендуется использовать действующую версию этого стандарта с учетом всех внесенных в данную версию изменений. Если заменен ссылочный стандарт, на который дана датированная ссылка, то рекомендуется использовать версию этого стандарта с указанным выше годом утверждения (принятия). Если после утверждения настоящего стандарта в ссылочный стандарт, на который дана датированная ссылка, внесено изменение, затрагивающее положение, на которое дана ссылка, то это положение рекомендуется применять без учета данного изменения. Если ссылочный стандарт отменен без замены, то положение, в котором дана ссылка на него, рекомендуется применять в части, не затрагивающей эту ссылку.

3 Термины и определения

В настоящем стандарте применены термины по ГОСТ Р ИСО/МЭК 38500, [2], а также следующие термины с соответствующими определениями:

3.1 Термины, связанные с искусственным интеллектом

3.1.1 использование искусственного интеллекта (use of Al): Разработка или применение системы ИИ на любом этапе ее жизненного цикла для достижения целей организации.

Примечание - Этот термин относится к любым действиям или деятельности, связанным с ИИ, которые могут иметь последствия для стратегического управления.

3.2 Термины, связанные со стратегическим управлением

3.2.1 надзор (oversight): Отслеживание реализации организационной политики, политики стратегического управления и управления соответствующими задачами, услугами и продуктами, установленными организацией, с целью адаптации к текущим внутренним или внешним обстоятельствам.

Примечание - Эффективный надзор требует общего понимания ситуации. Надзор является одним из "принципов стратегического управления", подробно рассмотренных в [7], (6.4).

3.2.2

риск (risk): Следствие влияния неопределенности на достижение поставленных целей. [ГОСТ Р ИСО 31000-2019, пункт 3.1] |

Примечания

1 Следствие влияния неопределенности - это отклонение от ожидаемого. Оно может быть положительным, отрицательным или и тем и другим и может устранять, создавать или приводить к возможностям и угрозам.

2 Цели могут иметь различные аспекты и категории и могут применяться на разных уровнях.

3 Риск обычно выражается в терминах источников риска, потенциальных событий, их последствий и вероятности.

3.2.3

риск-аппетит (risk appetite): Величина и тип соответствующего риска, который организация готова поддерживать или достичь. [ГОСТ Р 51897-2021, статья 4.7.1.2] |

3.2.4 принятые обязательства (compliance obligations): Требования, которые организация должна соблюдать в обязательном порядке, а также требования, которые организация выбирает добровольно.

Примечание - Определение приведено в [8], (3.25).

3.2.5 соответствие (compliance): Выполнение всех принятых обязательств организации (3.2.4).

Примечание - Определение приведено в [8], (3.26).

4 Последствия влияния стратегического управления при использовании ИИ организациями

4.1 Общие положения

Стратегическое управление организаций обеспечивается применением принципов, способствующих достижению организационной цели и при этом создающих ценность для организации и ее заинтересованных сторон. Согласно ГОСТ Р ИСО 31000-2019 (5.3), в рамках стратегического управления определяется курс организации, ее внешние и внутренние взаимоотношения, а также правила, процессы и практики, необходимые для достижения ее цели. Структуры оперативного управления отражают направления стратегического управления и соответствующие цели, необходимые для достижения поставленных уровней устойчивой производительности и долгосрочной жизнеспособности.

Обзор концепций стратегического управления и принятия организационных решений (и, в частности, ссылки на существующие стандарты: [7], ГОСТ Р ИСО/МЭК 38500, [9]), которым необходимо следовать, приведен в приложении А.

Ответственность руководящего органа за постановку целей в традиционном контексте распространяется как на финансовые цели, так и на нефинансовые результаты, включая культуру, ценности и этические аспекты. Разработка и исполнение политики организации, включая политику стратегического управления, обычно обеспечиваются посредством сочетания средств управления, бизнес-планов, стратегий, должностных инструкций, принятой профессиональной практики, нормативных документов, обучения, ключевых показателей деятельности и различных форм коммуникаций с руководством.

Руководящий орган несет ответственность за всю деятельность организации, а также должен отвечать за результаты внедрения новых инструментов, техники или технологий для ведения деятельности организации.

Членам руководящего органа следует убедиться самим и быть в состоянии продемонстрировать заинтересованным сторонам, что их политика (совместно с реализацией данной политики) является достаточной для организации, для качественного производства ее продукции и надлежащего взаимодействия, а также для сохранения человеческих ресурсов, процессов и технологий, которые использует организация. Однако ИИ обладает потенциалом, способствующим возникновению целей, а также более результативному и эффективному достижению и/или расширению существующих целей организации.

4.2 Поддержание стратегического управления при внедрении ИИ

Руководящий орган устанавливает цель организации и утверждает стратегии, необходимые для достижения этой цели. Однако, возможно, что существующее стратегическое управление уже не соответствует своему назначению, когда в организации используется ИИ. Необходимо, чтобы конкретный выбор инструментов, например систем ИИ, был решением руководства, принятым с учетом и в соответствии с указаниями руководящего органа. Для того чтобы выработать такое руководство, руководящему органу следует ознакомиться с ИИ в общих чертах, поскольку его использование может привести к возникновению:

- значительной выгоды для организации в стратегическом плане;

- существенного риска для организации, чреватого нанесением ущерба ее заинтересованным сторонам;

- дополнительных обязательств у организации.

Руководящему органу следует оценить предполагаемое использование ИИ в рамках своего риск-аппетита, который быстро меняется. Новые знания и проактивный подход дают организации возможность реагировать на риск. Поэтому организации следует продемонстрировать готовность к изменению или отмене проектов, если это будет сочтено необходимым. Дополнительное руководство приведено в ГОСТ Р ИСО/МЭК 38506.

Использование ИИ приводит к новым последствиям, включая, но не ограничиваясь следующими:

- повышенная зависимость от технологий и систем для комплектования данных и обеспечения их качества;

- необходимость обеспечить прозрачность и объяснимость систем ИИ (включая понимание целей, предположений и включенных в них правил), когда частично или полностью автоматизированные системы используют для решения задач, которые ранее выполнялись людьми (например, оценка кредитоспособности), совместно с адекватными процессами изменения и обновления этих алгоритмов;

- возможность того, что существующие направления и средства управления не подходят для обеспечения требуемых результатов (и снижения риска нежелательных последствий) или даже могут быть скомпрометированы. Это связано с различиями в допущениях, которые могут быть сделаны при делегировании полномочий человеку, в отличие от использования или получения поддержки от ИИ.

Пример - Инструкция "отложить погашение кредита до окончания праздников" достаточно понятна в контексте для другого человека-оператора, но недостаточно точна для правильного выполнения системой ИИ;

- конкурентное давление из-за продаж и деятельности организации, не использующей ИИ;

- принятие решения использования систем ИИ без осознания или рассмотрения потенциальной предвзятости, ошибок, или вреда, или последствий внедрения ИИ в существующие сложные системы;

- растущее несоответствие между быстротой изменений в автоматизированных системах обучения и связанных с ними человеко-ориентированных мер и средств обеспечения исполнения законодательно-нормативных требований;

- влияние ИИ на рабочую силу, включая опасения по поводу дискриминации, ущерба фундаментальным правам работников, увольнения в результате автоматизации или снижения требований к квалификации и переподготовке, возможной потере организационных знаний, а также использование ИИ для повышения творческого потенциала человека, повышения качества работы за счет делегирования повторяющихся, тривиальных или опасных задач системе ИИ;

- влияние на коммерческую деятельность и репутацию бренда.

Использование ИИ также может снизить или устранить некоторые существующие риски, и руководящему органу следует пересмотреть и соответствующим образом скорректировать свою оценку рисков.

Пример - Система ИИ может снизить риск ошибок, когда она используется в дополнение к персоналу, выполняющему повторяющиеся задачи, или когда персонал должен постоянно отслеживать системы в поисках редких отклонений (например, охранники).

4.3 Сохранение подотчетности при внедрении ИИ

Члены руководящего органа несут ответственность за контроль/надзор над деятельностью организации и за результаты этой деятельности, а также за системы и методы работы, позволяющие обеспечить уверенность в них. Они отвечают за решения, принимаемые в организации, включая решения, которые принимают с использованием ИИ, а также за адекватность стратегического управления и средств управления в местах внедрения ИИ. Таким образом, они отвечают за использование ИИ, которое организация считает приемлемым.

Руководящему органу следует принять на себя ответственность за использование ИИ, а не возлагать ответственность на систему ИИ. Члены руководящего органа несут ответственность за осведомленность о возможностях и рисках, связанных с использованием систем ИИ. Они должны осознавать риск антропоморфизации ИИ - явления, при котором человеческие характеристики (например, мышление, эмоции, суждения, морализация) неоправданно приписываются системам ИИ, не пропорционально или несоответствующим образом по сравнению с тем, что необходимо для понимания того значения, которое имеет использование ИИ.

Члены руководящего органа могут быть привлечены к ответственности за неправильные действия организации в тех случаях, когда недостаточное проявление должной осмотрительности, недостаточные забота, руководство, обучение, надзор и принуждение в организации позволяют возникнуть проблемам. Такая ответственность может быть обеспечена самим руководящим органом, продиктована заинтересованными сторонами или установлена другими способами. Члены руководящего органа могут быть наказаны, отстранены от должности или привлечены к удовлетворению требований в судах.

Поэтому руководящему органу следует убедиться в том, что его практика соответствует конкретным целям, для которых ИИ применяют в организации. Это может включать пересмотр и, при необходимости, совершенствование следующего:

- направление: посредством политики, стратегии, распределения ресурсов, кодексов этики, заявлений о ценностях, целей или принятия других документов, касающихся использования ИИ в организации;

- надзор: посредством оценки ИИ, оценивания его ценности для организации и риск-аппетита организации, а также обеспечения внедрения, отслеживания, измерения, принятия решений и других механизмов, связанных с использованием ИИ в организации;

- оценка: рассмотрение различных элементов, например: внутренних и внешних факторов, относящихся к организации, текущих и потенциальных угроз и возможностей, достигнутых результатов, результативности и эффективности действующих механизмов стратегического управления, а также суждений о принятых решениях и вариантах;

- отчетность: демонстрация заинтересованным сторонам того, что использование ИИ результативно регулируется ответственными лицами (сравнивают это с задачами "оценивать", "направлять" и "отслеживать" в ГОСТ Р ИСО/МЭК 38500-2017, 4.2).

Руководящему органу также следует убедиться в том, что он обладает достаточными возможностями для решения задач, связанных с последствиями использования ИИ. Действия по решению задач могут включать:

- совершенствование навыков, связанных с ИИ, среди своих членов;

- увеличение частоты проверки использования организацией ИТ в целом и ИИ в частности;

- изучение и обновление критериев, используемых для отслеживания как внутренней, так и внешней среды;

- обеспечение представления интересов и прав персонала (например, безопасность на рабочем месте, обучение персонала, качество работы);

- усиление надзора путем создания или усиления подкомитетов, занимающихся вопросами стратегии, рисков, оценки или аудита, а также этики.

Ответственность руководящего органа следует установить по всем аспектам предполагаемого или фактического использования ИИ и таким образом, чтобы обеспечить достижение намеченных результатов, а именно:

- при рассмотрении потенциальных последствий использования ИИ;

- при разработке бизнес-стратегий, включающих использование ИИ;

- на этапах приобретения, внедрения, конфигурации, развертывания, тестирования и других этапах проекта на протяжении всего жизненного цикла системы ИИ;

- при изменениях в той среде, которой подвергается ИИ, включая обучение и действия, решения и результаты работы системы ИИ, а также ее воздействие на заинтересованные стороны;

- наличие соответствующих методов обеспечения безопасности для защиты организации, ее заинтересованных сторон и ее данных;

- при выводе из эксплуатации, включая знания и данные, которые содержатся в системе ИИ.

Наряду с задачами, связанными с ИИ, существуют и другие задачи, в отношении внедрения новых технологий, которые могут повлиять на организацию и ее заинтересованные стороны, в том числе:

- неправильное понимание природы технологий;

- принятие неадекватных стратегических управленческих решений;

- отсутствие надлежащего стратегического управленческого надзора за ИИ;

- неспособность включить ИИ в область распространения существующего стратегического управления;

- неуместное или повсеместное применение технологий без учета контекста, соответствующего планирования, политики или обучения;

- неспособность защитить и обезопасить информацию и активы от автоматизированных атак, использующих ИИ для выявления уязвимостей;

- неспособность рассмотреть последствия возникающих связей между людьми и системами ИИ.

5 Обзор ИИ и систем ИИ

5.1 Общие положения

Системы ИИ существуют в различных формах и требуют разной степени надзора со стороны руководящего органа. Таким образом, необходимо, чтобы руководящий орган понимал, какие последствия влечет за собой использование ИИ и на каком этапе его применения следует вовлечь руководящий орган либо напрямую, либо через соответствующие механизмы стратегического управления.

Системы ИИ опираются на существующие возможности ИТ, включая сетевые технологии, устройства Интернета вещей, например датчики и исполнительные механизмы, большие данные и облачные вычисления.

Большинство последних достижений в области технологий ИИ относятся к области машинного обучения (МО). МО - это технология ИИ, которая дает компьютерам возможность "учиться" без явного программирования. Данные являются ключевым фактором: они могут представлять собой, например, текст, числа, картинки, символы, формулы, графики, изображения, речь, звук или видео. С учетом существующего набора (обучающих) данных создается (настраивается) модель, которую применяют к новым данным для решения конкретной задачи, прогнозирования результата или классификации новых входных данных.

Характер систем ИИ, основанных на МО, включая цель их использования, выбор алгоритмов, подход, основанный на данных, методологии обучения и результаты, основанные на вероятности, такой, что существует потенциал дополнительного риска как непосредственно для организации, так и для ее возможностей (см. также 6.7).

Системы ИИ могут автоматизировать процесс принятия решений, анализируя данные для получения потенциального вероятностного результата и, во многих случаях, действуя в соответствии с этим результатом. Системы ИИ могут изменить характер продуктов, процессов и отношений, а также методы работы организации. Это может оказать существенное влияние на большинство отраслей.

Как и в случае с другим мощным инструментом, наряду с возможностью получения полезной отдачи также существует потенциал для причинения вреда, поэтому использование ИИ должно быть включено проводимой организацией в оценку риска.

Использование ИИ может привести к появлению у организации новых обязательств, как вытекающих из требований законодательства, так и являющихся следствием внедрения организацией добровольных кодексов практики, что может происходить как непосредственно в ходе автоматизации системой ИИ процессов принятия решений, так и косвенно посредством использования данных или иных ресурсов и процессов. Основным вопросом, на который следует обратить внимание руководящему органу, является потенциальная возможность пересечения системой ИИ границы между демонстрацией вариантов выполнения действий и самостоятельным выполнением действий без участия человека.

От других технологий ИИ отличают внушительный объем и сложность обрабатываемых данных, собираемых из разнообразных источников, которые могут быть чрезмерно сложны для того, чтобы человек мог ими манипулировать или адекватно обрабатывать. С точки зрения последствий для стратегического управления технологии ИИ отличают:

- возможность автоматизации принятия решений;

- использование для решения задач анализа данных, понимания и обучения, а неявным образом запрограммированной человеком логики решения задач;

- способность адаптироваться по мере изменения окружения системы ИИ, причем такими способами, которые не запрограммированы в явном виде и не обязательно установлены заранее.

Эти три элемента имеют разные последствия для организации и ее стратегического управления.

5.2 Отличия систем ИИ от других информационных технологий

5.2.1 Автоматизация принятия решений

Системы ИИ обычно выдают результаты на основе архивных и текущих данных, выбранных для тех задач, для которых система ИИ предназначена. В современных системах ИИ, в частности основанных на МО, итоговый прогноз обычно определяют как возможный с определенной вероятностью.

Например:

- вероятность того, что эта деталь не соответствует требованиям качества, составляет 97%;

- вероятность того, что этот маршрут будет наиболее быстрым, составляет 92%;

- с вероятностью 98% лицо перед камерой принадлежит Петру Иванову.

На основе этих вероятностей система ИИ может предпринять различные действия (действия, которые могут меняться со временем в результате переобучения). В некоторых случаях автоматические решения могут приниматься за доли секунды.

Скорость принятия таких решений является ключевым элементом систем ИИ, что делает их мощными инструментами для использования организациями. Процесс автоматизированного принятия решений может учитывать большие объемы и разнообразие входных данных.

5.2.2 Решение задач под влиянием данных

Системы ИИ, в частности, основанные на МО, обычно изучают большие объемы данных, выявляют и уточняют закономерности, обнаруженные в этих данных. Такая способность позволяет подобным системам решать определенные типы задач, которые чересчур сложны или трудоемки для самостоятельного решения человеком или с помощью классических методов программирования.

Вместо управления каждым логическим шагом и программирования решения задач человеком, на этот процесс влияют определенные данные, например:

- распознавание лица - это то, что люди делают очень хорошо, но описать, как именно это достигается, достаточно сложно. Системы ИИ достигают этого путем изучения тысяч изображений лиц, изучения закономерностей в этих данных и применения этих закономерностей к новым изображениям лиц;

- процесс поиска раковой клетки среди миллионов здоровых клеток предельно сложный, но методы МО для распознавания изображений оказались применимы для диагностики рака.

Все более широкое использование МО вместе с постоянно меняющимися данными (если система развивается благодаря переобучению и непрерывному обучению) значительно ускоряет решение задач и несет в себе значительный потенциал, а также вызовы для стратегического управления.

5.2.3 Адаптивные системы

Некоторые системы ИИ на этапе эксплуатации проходят переобучение либо обучаются постоянно. Входные данные, полученные во время работы, используются системой ИИ для усовершенствования и оптимизации своих внутренних моделей. Таким образом, со временем такие системы ИИ могут генерировать различные результаты на основе одних и тех же входных данных. Подобная адаптация может развиваться как реакция на внешние стимулы, такие как изменения в окружающей среде или обратная связь, поступающая в систему ИИ. В качестве примера приведена рекомендательная система, которая отслеживает реакцию пользователя на свои рекомендации и адаптируется для повышения коэффициента их принятия, что и является непрерывным обучением (см. [1], 3.1.10).

Адаптация также может быть результатом самосовершенствования, например в системе ИИ, играющей в шахматы, которая способна обучаться, играя сама с собой.

Такие адаптивные системы также имеют следующие последствия для стратегического управления:

- потенциально от системы ИИ может потребоваться наличие средств, позволяющих понять ее функционирование, например при проведении оценки или аудита;

- поскольку функциональность системы ИИ со временем меняется, для обеспечения уверенности в том, что система по-прежнему работает в приемлемых границах, могут потребоваться дополнительные оценки или другие механизмы контроля;

- адаптивность системы ИИ может повысить маневренность организации и обеспечить ей стратегическое преимущество;

- системы ИИ могут непреднамеренно обходить требования и ограничения, установленные существующими инструментами стратегического управления. Руководству следует обеспечить, чтобы системы ИИ явным образом соответствовали таким требованиям и ограничениям.

5.3 Экосистема ИИ

Понимание многочисленных компонентов системы ИИ и того, как они могут быть связаны с организацией, требует многослойного подхода к экосистеме ИИ.

Как показано на рисунке 1, экосистема ИИ обширна и включает в себя спектр различных технологий [более подробная версия этого рисунка приведена в [1], (рисунок 6), где более подробно описаны элементы МО и вычислительные ресурсы]. Если использованы средства реализации ИИ, некоторые из других компонентов этой экосистемы становятся функциональной частью общей системы ИИ и их следует рассматривать с точки зрения стратегического управления.

|

Рисунок 1 - Упрощенная версия экосистемы ИИ (см. [1], рисунок 6)

Такое многослойное представление экосистемы ИИ может помочь определить уровень и объем подотчетности в зависимости от роли организации в экосистеме, а также соответствующий уровень подотчетности руководящего органа.

Сложная природа экосистем ИИ означает, что объем надзора будет существенно варьироваться в зависимости от нескольких факторов, включая:

- целевое назначение системы ИИ;

- тип используемого ИИ;

- функциональный слой используемой экосистемы ИИ;

- потенциальную пользу, которую принесет система ИИ;

- новые риски, которые могут сопровождать систему ИИ;

- этап внедрения системы ИИ;

- место, которое занимает организация в цепочке создания ценности ИИ, например роль поставщика, производителя, потребителя ИИ (см. [1], 5.17).

На эти факторы влияют цель и задачи организации, а также решение об использовании системы ИИ, более приоритетной относительно других ИТ. Эти факторы в основном учитывают в начале разработки и развертывания системы ИИ. Однако существуют и другие организационные соображения, которые следует принимать во внимание на протяжении всего жизненного цикла.

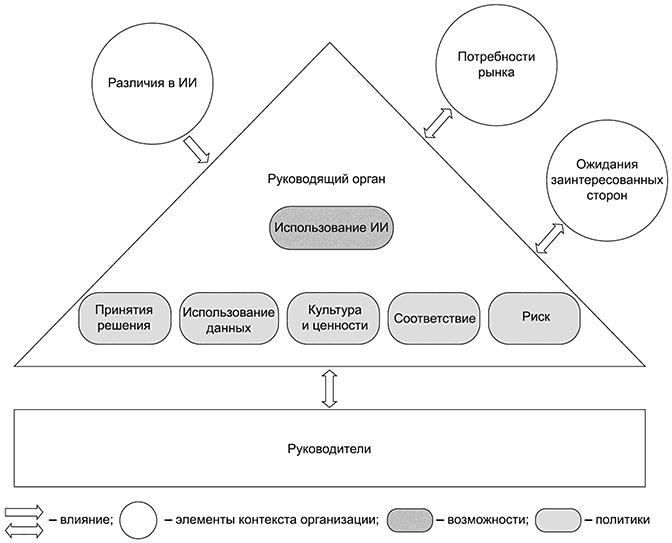

На рисунке 2 показан жизненный цикл системы ИИ с момента зарождения до вывода из эксплуатации. После того как организация приняла решение об использовании ИИ, это может помочь руководящим органам определить точки или "ворота", на которых могут возникнуть ключевые вопросы стратегического управления, требующие решения со стороны руководящего органа.

С учетом жизненного цикла системы ИИ организация может определить, как развивать существующие механизмы стратегического управления, а также, где требуется дополнительное стратегическое управление, учитывая зависимость системы ИИ от данных. Стратегическое управление данными рассмотрено в [9], [10], [11]. Жизненный цикл также может помочь руководящему органу определить на каждом этапе, где организация может испытывать дополнительные риски, а затем принять решения о том, как управлять такими рисками. В 5.4 и 5.5 более подробно описаны дополнительные особенности по стратегическому управлению, возникающие при использовании ИИ.

|

Рисунок 2 - Модель жизненного цикла системы ИИ (см. [1], рисунок 3)

5.4 Преимущества использования ИИ

Руководящий орган может рассмотреть вопрос о внедрении ИИ для реализации конкретных возможностей, выявленных организацией, включая потенциальное развитие организации или более эффективное достижение целей и задач организации. В таких случаях руководящему органу необходимо сопоставить эти возможности с риском и другими последствиями использования и обеспечить наличие и использование механизмов надзора для проверки того, соответствует ли развертывание стратегическому замыслу, целям и ценностям организации. ИИ можно использовать для достижения целей и создания ценностей для организации. Это может привести к следующему:

- к снижению операционных расходов;

- появлению новых продуктов и услуг, которые значительно изменят существующие способы ведения деятельности, или

- преобразованию организаций, таких как государственные структуры или некоммерческие организации.

В настоящее время практически все организации используют ИИ в повседневной деятельности, иногда даже не осознавая этого. Примерами такого использования могут служить:

- использование спутниковой навигационной системы, которая находит наиболее эффективный маршрут для грузоперевозок;

- большинство поисковых запросов в Интернете, которые используют ИИ для ответа на запрос, поиска схожей картинки или документа;

- офисные приложения, которые используют ИИ, чтобы предложить совершенный дизайн слайда в презентации или улучшить грамматику в документе.

Дальнейшее применение можно найти в различных областях (например, сельское хозяйство, оборона, образование, здравоохранение, производство, транспорт) и использовать различные модели развертывания (например, облачные услуги или системы на объектах, киберфизические системы). Составленная обширная коллекция примеров использования приведена в [12], включающая эти и другие области и модели развертывания.

Система ИИ может, например:

- изменить характер продуктов, процессов и услуг;

- автоматизировать сбор данных об обратной связи, сравнение, перевод, проверку или анализ, оставляя за человеком деятельность, приносящую наибольшую полезную отдачу (например, выводы, которые нужно сделать, или решения, которые нужно принять);

- повысить уровень обслуживания клиентов, производительность и качество продукции;

- изменить отношения с клиентами и поставщиками (а значит, и между сотрудниками, клиентами и цепочками поставок) с помощью интеллектуальных агентов, таких как чат-боты, для сбора необходимой информации, сортировки и маршрутизации запросов, помощи в вопросах, связанных с продуктами, услугами или выставлением счетов, или решения задач;

- повысить эффективность в промышленности и сельском хозяйстве путем перехода от автоматизированной помощи к полностью автоматической поддержке;

- определить наиболее вероятное намерение говорящего на основе образцов разговорного языка;

- прогнозировать распространение болезней на основе исторических данных о подобных вспышках заболеваний;

- предположить возможный случай рака на основе изучения клеток;

- рекомендовать предоставление или отказ в предоставлении кредита.

Такое использование ИИ может как принести пользу организации, так и создать новые или обострить существующие проблемы, такие как возникновение дополнительных рисков или предвзятость, в том числе вопросы, которые более подробно рассмотрены в разделе 6.

Используя ИИ, организация может изменить свою стратегию и применить модели, подходящие для ее сектора. Организация может изменить то, каким образом она приносит пользу своим заинтересованным сторонам, и способы получения этой пользы. Использование ИИ также создает возможности для рабочей силы, например: повышение творческого потенциала, мобилизуемого с помощью ИИ, повышение конкурентоспособности и различные возможности работы, исключающие повторяющиеся, тривиальные или небезопасные задачи. Таким образом, технологии ИИ могут принести глубокие преобразования в организации. Руководящему органу следует узнать о возможностях, которые ИИ открывает для организации, и способствовать их внедрению, когда это целесообразно.

Используя ИИ для решения таких задач, организация может сосредоточить усилия и ресурсы на тех задачах, в которых полезная отдача зависит от усилий человека и не может быть автоматизирована или воспроизведена ИИ.

5.5 Ограничения на использование ИИ

Хотя организация может легко определить преимущества использования ИИ, руководящему органу следует понимать ограничения и обязательства, которые накладывает на организацию такое применение. Чтобы адекватно регулировать эти ограничения и обязательства, организации следует предпринять некоторые из следующих действий:

- усилить надзор за соответствием требованиям. В отсутствие надлежащего контроля и надзора использование ИИ для автоматизации процессов может приводить к нестабильным результатам, которые сложно объяснить и воспроизвести и которые могут противоречить политикам организации (см. 6.6);

- рассмотреть сферу использования. Убедитесь в том, что сфера автоматизации контролируется руководящим органом и что автоматизация осуществляется соответствующим образом уполномоченным квалифицированным персоналом (см. 6.3). Руководящему органу следует обеспечить наличие необходимых полномочий, ответственности и подотчетности, а также изучить и понять последствия такой автоматизации до ее внедрения;

- оценить воздействие на заинтересованные стороны и принять меры в случае необходимости. Хотя некоторые решения будут негативно влиять на заинтересованные стороны (например, отказ в банковском кредите клиенту), организации следует убедиться в том, что такое влияние не усугубится в результате использования ИИ. Необходимо позаботиться о сохранении как актуальности существующих оценок рисков и воздействий (см. 6.7), так и эффективности процессов их смягчения, таких как процессы защиты законных прав или обеспечения правовой определенности;

- определить требования законодательства или обязательства по использованию такой технологии. Возрастает вероятность того, что применение ИИ и взаимосвязанных с ним таких решений, как распознание лиц или для автоматического управления транспортными средствами, может быть оспорено или стать предметом новых требований законодательства. Руководящий орган должен продемонстрировать, каким образом исполняются такие обязательства, и показать, что применение ИИ соответствует требованиям, а его результаты, где это требуется, должным образом объясняются;

- согласовать использование ИИ с целями организации. Инновационное применение новых технологий имеет решающее значение для жизнеспособности и здоровья многих организаций, и в таких случаях политика стратегического управления будет поощрять такие инновации. Не каждый проект будет стратегически значимым (например, некоторые только сократят расходы), но в целом необходимо, чтобы использование ИИ способствовало достижению целей организации;

- привести использование ИИ в соответствие с культурой и ценностями организации. Необходимо, чтобы решения, предлагаемые системой ИИ, учитывали политику организации, ожидания (включая последствия использования) и этические нормы;

- убедиться в том, что при решении задачи должным образом учитывается контекст. Организации необходимо обеспечить, чтобы элементы контекста, значимые для понимания поведения, ценностей и культуры, не были потеряны или пропущены в данных, которые она использует для решения задач;

- изучить дополнительный риск, который может принести организации использование ИИ. Изучив цель и задачи организации и рассмотрев возможные источники риска, выявленные в случае принятия решения об использовании ИИ, а также меры по обработке этих рисков, организации следует оставаться в рамках своего риск-аппетита (см. 6.7).

Помимо этих общих ограничений на использование ИИ организацией (и других, применимых к организации или ее заинтересованным сторонам), системы ИИ будут иметь технологические ограничения. Руководящему органу, занимающемуся вопросами стратегического управления, следует также получить от руководителей, отвечающих за оперативную деятельность, подтверждение того, что обеспечивается адекватное управление такими ограничениями.

6 Политика в отношении использования ИИ

6.1 Общие положения

Системы ИИ используют данные для построения моделей и прогнозирования, а также потенциальной автоматизации решений и действий. Как и при любом применении человеческих ресурсов, процессов или технологий, руководящий орган остается ответственным за эти решения и действия. Некоторое использование ИИ может непреднамеренно привести к несоответствию политике или к тем результатам, которые не предусмотрены существующей политикой.

Выбор и утверждение направлений и средств управления, которые подходят для организации, не использующей ИИ, потенциально не подходят для организации, использующей ИИ.

Сохранение постоянного результативного стратегического управления требует проверки и возможного усиления существующих механизмов стратегического управления и средств управления для обеспечения их надежности, четкости и адекватности для учета дополнительных предположений стратегического управления (а также указаний руководству), которые системы ИИ дополняют к уже действующим в организации и ее заинтересованных сторон.

Руководящему органу и менеджерам следует дополнительно привлекать заинтересованные стороны, на которые может повлиять использование систем ИИ, такие как персонал и его представители, на протяжении всего процесса внедрения систем ИИ в организациях с помощью процедур информирования, консультаций и участия.

В этом подразделе приведены руководящие указания руководящему органу для того, чтобы понять и пересмотреть политику, которую ему следует рассмотреть, чтобы уменьшить возникновение предотвратимых и непреднамеренных последствий использования организацией ИИ. Приведенные руководящие указания не являются и не могут быть всеобъемлющими.

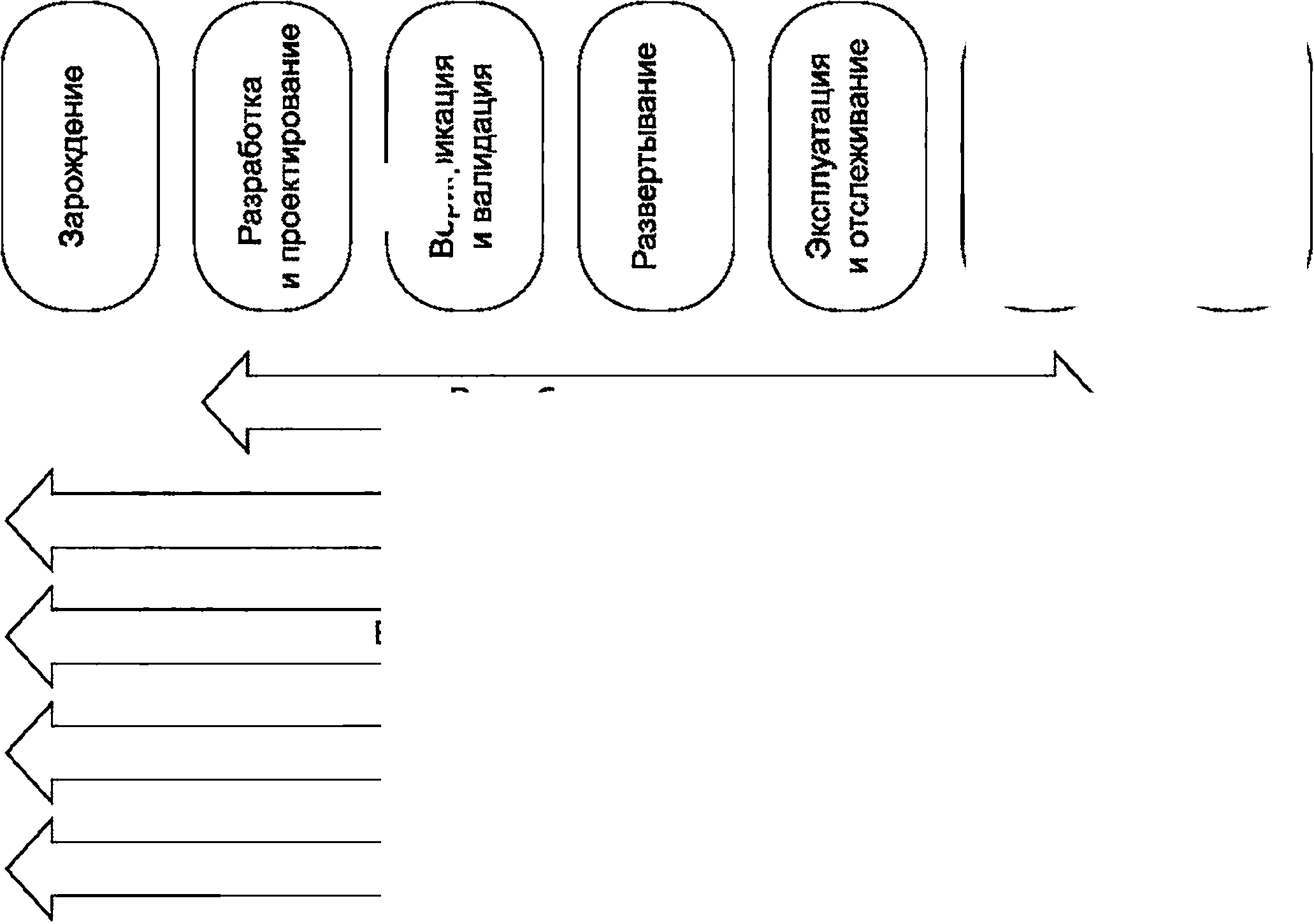

Согласно ГОСТ Р 58608-2019 (4.1.3) менеджеры отвечают за достижение целей организации в рамках стратегий и политики, установленных руководящим органом. Задача стратегического управления решается в тесном сотрудничестве между руководящим органом и менеджерами, как показано на рисунке 3.

|

Рисунок 3 - Последствия влияния стратегического управления при использовании ИИ

Схема, представленная на рисунке 3, основана на модели стратегического управления ИТ, приведенной в ГОСТ Р ИСО/МЭК 38500-2017 (рисунок 1) и модифицирует ее (см. рисунке А.1).

Независимо от использования какой-либо технологии, руководящему органу следует устанавливать и контролировать достижение тех результатов, которые соответствуют его принципам. Такие принципы могут возникнуть внутри организации, быть предложены или навязаны внешними организациями (см. [13]-[16]).

Необходимо, чтобы скорость технологических инноваций и постоянно меняющиеся требования законодательства способствовали тому, чтобы в организации активно поддерживался набор принципов использования ИИ и велось наблюдение за тем, чтобы требования были подходящими для использования ИИ в организации.

6.2 Надзор за стратегическим управлением ИИ

Руководящему органу следует обеспечить создание механизмов надзора за ИИ и их соответствие рискам, связанным с использованием ИИ в организации.

Необходимо, чтобы надзор за стратегическим управлением, основанный на политике, установленной организацией, определял индивидуальную и коллективную подотчетность в цепи ответственности. Надзор за надлежащим стратегическим управлением следует основывать на общем понимании использования (и контекста использования) системы. Внешний и внутренний контексты рассмотрены в ГОСТ Р ИСО 31000-2019 (6.3.3) (см. также [3], 6.3.33).

В рамках надзора за стратегическим управлением ИИ руководящий орган должен обеспечить следующее:

- должны быть разработаны политики, обеспечивающие надлежащее использование ИИ;

- обязанности, цепочка ответственности, подотчетность, полномочия и потенциальное делегирование полномочий должны быть четко определены и согласованы как внутри организации, так и, где это применимо, между различными сторонами в любой цепочке создания ценности;

- должен быть адекватный контроль со стороны человека при использовании ИИ;

- каждый, кто использует ИИ или несет ответственность за его использование:

- имеет соответствующее представление об используемой системе ИИ,

- надлежащим образом информирован и обучен, в том числе знает, как и кому эскалировать задачи,

- имеет полномочия принимать решения (или знает, к кому обратиться с запросом о принятии решения) и знает, перед кем отчитываться,

- имеет достаточный контроль над системой ИИ, включая возможность вмешательства в случае необходимости.

6.3 Стратегическое управление процессом принятия решений

Стратегическое управление процессом принятия решений является частью общего стратегического управления организацией.

Полномочия и ответственность делегируются персоналу организации, чтобы распределить нагрузку от выполненной работы и принятых решений. Вне зависимости от того, как делегированы полномочия или ответственность, подотчетность за всю проделанную работу и принятые решения остается за руководящим органом (см. 4.3). Некоторые из этих решений и часть этой работы могут все чаще приниматься и выполняться системами ИИ, но руководящий орган остается подотчетным таким же образом, как и в случае, когда человек принимает решения или выполняет работу.

Пересмотр политики принятия решений в отношении использования ИИ призван обеспечить, чтобы человек или группа людей несли и сохраняли четкую ответственность за те решения, на принятие которых они делегировали полномочия и ответственность. Это происходит независимо от того, было ли решение частично или полностью автоматизировано.

Руководящему органу следует отслеживать типы решений и результатов, генерируемых автоматизированными системами, и направлять руководство на обеспечение того, чтобы такие системы были настроены на работу в приемлемых пределах путем внедрения соответствующих средств управления. Необходимо, чтобы такие средства управления обеспечивали руководящему органу надлежащую видимость соответствия процесса принятия решений политике организации, а также любых исключений из нее.

Управляющему органу следует убедиться в том, что активный надзор за такими средствами управления делегирован сотруднику с соответствующими ресурсами, который имеет полномочия принимать или инициировать ответные меры на выявленные проблемы. Использование автоматизированного принятия решений, осуществляемого системой ИИ, не меняет подотчетности руководящего органа (или ответственности любого делегированного органа) за такие решения.

Важные факторы, связанные с принятием решений в организации, включают:

- соответствие целям. Необходимо, чтобы решения соответствовали целям организации, не выходя за рамки выделенных ресурсов, определенного риска и других средств управления, установленных организацией;

- уровень ответственности. Обеспечение соответствия уровня принятия решений предоставленным полномочиям и ответственности, связанной с принятием решения, является наиболее значимым элементом надлежащего стратегического управления. Определение масштабов и последствий возможных решений и соответствие их уровням ответственности необходимо для того, чтобы дать сотрудникам возможность действовать надлежащим образом и тем самым сделать всю организацию более гибкой. Подотчетность человека за действия и решения, выполняемые системой ИИ, следует четко определить и возложить на сотрудников, имеющих соответствующие полномочия и инструменты для выполнения поставленных перед ними задач (например, возможность визуального контроля, надзор, контроль качества) и для принятия достаточных корректирующих действий в случае выявления проблем;

- способность принимать решения. Лицам, принимающим решения, следует иметь достаточные навыки и подготовку для принятия решений, за которые они отвечают. Должны быть внедрены средства управления для обеспечения адекватности систем ИИ поставленной перед ними задаче (см. [17]);

- процесс принятия решений. Заинтересованные стороны предъявляют все более высокие требования к прозрачности процесса принятия решений. Эта прозрачность включает требования к отчетности, стратегическое направление и взаимодействие со всеми внутренними и внешними пользователями. Вместе с повышением прозрачности растет и ожидаемый уровень вовлеченности и внимательности при принятии решений. Поэтому процессы принятия решений (вместе с действиями, необходимыми для смягчения последствий непродуманных решений) являются важным механизмом стратегического управления и будут приобретать все большее значение по мере расширения использования ИИ;

- надзор за принятием решений. Руководящему органу следует обеспечить надлежащий надзор, внедрение средств управления для обеспечения результативных возможностей принятия решений и надлежащую возможность визуального контроля как соответствия принимаемых решений политике организации, так и любых исключений. Для исключений в принятии решений, связанных с соответствием, следует определить необходимость в дополнительной прозрачности и подотчетности. Всем заинтересованным сторонам следует предоставлять соответствующие средства для выявления и сообщения о несоответствующем поведении или результатах принятия решений в целом (независимо от того, включают ли они системы ИИ или не включают), а также для получения значимого, своевременного и адекватного ответа.

6.4 Стратегическое управление использованием данных

Некоторые системы ИИ опираются на данные для построения и обучения модели, поэтому стратегическое управление применением данных имеет решающее значение для ответственного использования ИИ. Руководящему органу следует на ранней стадии убедиться в том, что существующее стратегическое управление и руководство адекватны целям использования данных и что конфиденциальные данные защищены и обеспечены (см. [9]). Это включает, например, документирование того, как организация соблюдает свои обязательства, в том числе в отношении закупок и продажи, конфиденциальности и безопасности, хранения и удаления данных, а также надзор за собственной политикой в отношении управления данными (см. также 6.7.4).

Дополнительные соображения по стратегическому управлению при использовании данных для систем ИИ включают:

- соответствующие проектные решения, принятые для системы ИИ;

- сбор данных;

- соответствующие операции по обработке подготовки данных, например разметка, маркировка, очистка, обогащение и структурирование;

- формулирование соответствующих предположений, в частности в отношении информации, которую данные измеряют и представляют;

- предварительную оценку наличия, качества, количества и пригодности данных;

- экспертизы с учетом возможной предвзятости;

- выявление любых возможных пробелов или недостатков данных, а также способов устранения этих пробелов и недостатков.

Одно из основных отличий систем ИИ (в частности, систем МО) от других систем ИТ заключается в том, что они полагаются на вывод данных для получения результата с определенным уровнем достоверности. Другим существенным отличием является наличие и использование обучающих данных, которые, в зависимости от их качества, могут улучшить или ухудшить качество любого результата. Это отличается от разработки программного обеспечения, которое рассчитано на людей, разрабатывающих и программирующих конкретные логические шаги, необходимые для получения результата. В 5.2.2 и 5.2.3 описывается, чем отличаются такие системы. Поскольку качество данных имеет решающее значение для работы систем ИИ, руководящему органу следует получить от руководства подтверждение того, что данные имеют необходимое качество для их предполагаемого использования в системах ИИ.

В зависимости от области применения, использование архивных данных для обучения системы ИИ может привести к:

- повторению предыдущих ошибок;

- принятию "необоснованных" решений в отношении результатов, не зафиксированных в данных;

- принятию решений в отношении новых комбинаций обстоятельств или данных, которые трудно понять человеку, например связывание различных наборов данных, которые явно не связаны между собой;

- предоставлению информации о наблюдении и поведении, которая не обязательно раскрывается добровольно.

Эти результаты следует понимать как ошибки или погрешности, возникающие из-за использования неполных, ошибочных или несоответствующих данных. Иногда (и часто неверно) это называют "предвзятость ИИ". Однако предвзятость вносится или усиливается людьми, а не самими системами ИИ (см. также 6.7.4).

В тех случаях, когда данные используют в системах ИИ, следует проверить существующие методы стратегического управления применением данных и практики управления данными. Кроме того, для совместно используемых систем ИИ, например для анализа отраслевой деятельности, могут потребоваться дополнительная политика стратегического управления и средства управления со стороны руководства.

Другие технологические активы (например, алгоритмы, нейронные сети и системы обработки естественного языка) также могут потребовать аналогичных усовершенствований в существующих организационных и стратегических управленческих политиках.

Организации следует рассмотреть возможность применения положений [9], относящихся к использованию данных. К этим аспектам стратегического управления использованием ИИ относятся:

- ценность: качество и количество данных, их своевременность, контекст и стоимость их использования;

- риск: безопасность данных, неправомерное использование и конфиденциальность, а также конкурентные риски, связанные с неэффективным использованием данных;

- ограничения: требования законодательства, договорные обязательства, авторские или коммерческие интересы (см. также А.3 о стратегическом управлении использованием данных).

Данные и их использование организациями становятся все более важным вопросом для всех организаций и их заинтересованных сторон. В соответствии с принципами, моделями и специфическими для данных аспектами стратегического управления, изложенными в [9], руководящим органам следует предпринимать действия, обеспечивающие результативное стратегическое управление и инвестиции в использование данных организацией, а также учитывать риски, связанные с этим использованием. Это включает в себя обеспечение того, что корректные данные используют для подходящих целей.

6.5 Культура и ценности

Руководящий орган отвечает за определение желаемой культуры и ценностей организации в отношении заинтересованных сторон, рынков и регулирующих органов, а также изменений в ожиданиях общества в отношении деятельности и воздействия организации. Руководящим органам следует знать о появляющихся рекомендациях и международных нормах поведения, таких как те, что отражены во Всеобщей декларации прав человека [18], Йоханнесбургской декларации по устойчивому развитию [19], российском Кодексе этики в сфере искусственного интеллекта [4] и других документах. Более подробную информацию можно найти в ГОСТ Р ИСО 26000-2012 (3.3.2).

Любое решение или действие организации должно соответствовать ее культуре и ценностям. Однако большая часть культуры и ценностей организации неявно заложена в поведении ее сотрудников и процессах. Система ИИ не имеет эквивалента человеческого понимания контекста, здравого смысла, морали или знаний, чтобы направлять свои действия. Вместо этого система ИИ полагается на модели, алгоритмы или обучающие данные для достижения сопоставимых результатов.

По этим причинам руководящему органу следует четко определить свою культуру и ценности и иметь соответствующие механизмы и политику стратегического управления, чтобы обеспечить отслеживание и корректировку такого поведения системы ИИ в случае необходимости. В некоторых случаях необходимо, чтобы масштабы и воздействие системы ИИ были ограничены и дополнены действиями человека, чтобы можно было обеспечить соблюдение политики стратегического управления. Как этого добиться, будет зависеть от конкретных обстоятельств. В равной степени система ИИ может помочь выявить, где в принятии решений человеком есть недостатки (например, неуместная предвзятость, или дискриминация, или плохое рассуждение, или дедукция) и таким образом дать представление для организации, которое руководящий орган может впоследствии рассмотреть. Это поднимает будущие проблемы стратегического управления организациями.

В зависимости от характера и цели предполагаемой к использованию системы ИИ, возможно, что организации потребуется осуществлять явный надзор за этими системами, чтобы обеспечить их соответствие культуре и ценностям организации. Механизмы стратегического управления могут принимать форму совета по культуре и ценностям или совета по рассмотрению вопросов этики. Надзор может заключаться в том, что перед утверждением чувствительных или высокорискованных проектов систем ИИ или при соблюдении определенных критериев эскалации необходимо провести проверку. Дополнительные политики организации в этой области могут требовать использования технических средств управления в системе ИИ для обеспечения соответствия этим политикам. Более подробная информация об этике и общественных проблемах, связанных с использованием ИИ, приведена в [20].

6.6 Соответствие требованиям

6.6.1 Принятые обязательства

Для обеспечения выполнения принятых обязательств организация устанавливает постоянный процесс обеспечения соответствия требованиям. Чтобы быть результативным, процесс обеспечения соответствия формируется руководством организации и внедряется в культуру организации. Система менеджмента соответствия, подобная описанной в [8], отвечает этим требованиям и помогает организации продемонстрировать свою приверженность выполнению обязательств и соответствовать ожиданиям заинтересованных сторон.

Руководящему органу следует получить гарантии того, что руководство настраивает и обслуживает любую систему ИИ, используемую организацией, для выполнения принятых организацией обязательств и во избежание нарушения соответствия требованиям. Примерами нарушений являются механизмы ценообразования, нарушающие антимонопольные требования законодательства, или использование данных для обучения, нарушающее гражданские права или носящее дискриминационный характер.

Соответствие требованиям касается поведения операционного персонала. ИИ может уменьшить влияние человеческого поведения в определенных ситуациях, тем самым снижая риск несоответствия, которое является результатом человеческого поведения. Как следствие, влияние человеческого фактора повышается или смещается в сторону тех, кто проектирует, разрабатывает и внедряет системы ИИ. Такое изменение ставит совершенно новую задачу в плане осведомленности, обучения и отслеживания.

При рассмотрении роли ИИ в контексте организации и принятых на себя обязательств руководящий орган должен рассмотреть следующие вопросы:

- ожидания заинтересованных сторон относительно использования и влияния ИИ (убедиться в том, что они соответствуют существующим политикам и принятым обязательствам);

- культурные последствия использования ИИ в организации, такие как повышенная сложность системы ИИ, которая может заставить сотрудников считать, что она не содержит ошибок. Организации следует установить соответствующие процессы для проверки результатов работы системы ИИ;

- степень использования ИИ в организации;

- влияние ИИ на соблюдение требований организации;

- изменения в риск-аппетите организации, возникающие в результате использования ИИ;

- степень, с которой существующие надзорные процессы, структуры и средства управления учитывают конкретные аспекты ИИ;

- влияние использования ИИ на структуры подотчетности в организации;

- существующая система менеджмента соответствия оценена с учетом последствий, связанных с использованием ИИ (когда, например, проекты и решения могут быть трудно объяснимы и подвержены частым изменениям), что может включать, например, расширение политики соответствия или расширение периодической оценки рисков;

- затрагиваются ли физические лица в результате использования или создания персональных данных системой ИИ, применение которой ограничено, например, законом или политикой организации.

6.6.2 Менеджмент соответствия

Использование стандарта системы менеджмента соответствия позволяет организации интегрирование совместить в своей системе менеджмента специфические требования к менеджменту, например к безопасности, качеству и конфиденциальности. Это облегчает добавление дополнительных мер по обеспечению соответствия в систему менеджмента, возникающих в результате использования ИИ.

На уровне менеджмента соответствия пристальное внимание должно быть уделено следующему:

- расширение процессов обеспечения соответствия с учетом скорости, масштаба или сложности системы ИИ (например, для повышения уровня или частоты отслеживания);

- запросы на повторную оценку человеком решений, принятых системой ИИ;

- дополнительные средства управления для обеспечения того, чтобы системы ИИ оставались в требуемых условиях соответствия;

- обеспечение соответствия политике использования данных для построения моделей или обучения;

- использование ИИ для отслеживания других систем ИИ и дополнительное отслеживание или оповещение, которые могут потребоваться.

Организации следует оценить влияние любого запланированного использования ИИ с помощью системы менеджмента соответствия таким образом, чтобы возможные варианты использования ИИ в рамках системы менеджмента были частью этой оценки.

6.7 Риск

6.7.1 Аппетит к риску и управление рисками

Стратегическое управление организацией, каким бы образом оно ни осуществлялось, включает в себя определение цели и задач организации, а также стратегии их достижения. При рассмотрении своей стратегии руководящий орган организации принимает решение о риск-аппетите для реализации своих целей. Чтобы оставаться в рамках этого риск-аппетита и помочь руководящему органу в принятии решений относительно риск-аппетита, организация устанавливает процесс управления рисками.

Управление рисками предполагает сбор соответствующей информации для принятия организацией решений в отношении рисков. Хотя руководящий орган определяет общий риск-аппетит и цели организации, он делегирует процесс принятия решений по выявлению, оценке и учету риска руководству организации. Различные роли стратегического управления и менеджмента в решении проблемы риска рассмотрены в настоящем стандарте, в котором описаны дополнительные соображения по стратегическому управлению организацией в отношении разработки, приобретения или использования системы ИИ. Такие соображения включают новые возможности, потенциальные изменения в риск-аппетите, а также новые политики стратегического управления для обеспечения ответственного использования системы ИИ в организации. Кроме того, описание процессов управления, которые следует выполнять в организации для устранения дополнительных рисков для организации в результате внедрения системы ИИ, приведено в [3].

В работе с рисками участвуют как руководящий орган, который определяет риск-аппетит и несет за него ответственность, так и руководство, которое работает над поддержанием риска в пределах согласованного риск-аппетита.

В ходе проверки текущих процессов управления рисками следует особенно тщательно изучить их на предмет понимания уровня и управления рисками, связанными с принятием решений, использованием данных, культурой и ценностями, а также с соответствием нормативным требованиям. Таким образом, можно прояснить контекст дополнительных рисков, которые системы ИИ привносят в организацию. Как только эти дополнительные риски будут определены, руководящий орган окажется в более выгодном положении для того, чтобы:

- обеспечить адекватный учет рисков при постановке целей организации;

- понимать риски, с которыми сталкивается организация при достижении своих целей;

- обеспечить внедрение и результативное функционирование систем управления такими рисками;

- обеспечить, чтобы такие риски находились в рамках риск-аппетита организации;

- обеспечить результативное распространение информации о таких рисках и управлении ими, используя, например, ГОСТ Р ИСО 31000-2019 (5.2).

6.7.2 Управление рисками

Управление рисками является неотъемлемой частью всей деятельности организации. Несмотря на то что системы ИИ могут принести пользу организации, цели организации, связанные с надлежащим стратегическим управлением процессом принятия решений, использованием данных, а также с предпочтительными культурой и ценностями организации, следует пересмотреть с учетом возможных последствий применения ИИ.

Организация стремится защитить собственные принципы и ценности, идентичность и репутацию, заинтересованных лиц, рынок, окружающую среду и, кроме того, защитить свободу действий, чтобы добиться надлежащего результата.

Для устранения рисков, связанных с ИИ, руководящему органу следует создать:

- соответствующие внутренние правила и политики;

- соответствующие конкретные под организации, процессы и инструменты, призванные гарантировать или обеспечивать соблюдение ценностей, принципов и внутренних средств управления, которые являются основой надлежащего стратегического управления.

Кроме того, руководящему органу следует обеспечить, чтобы там, где это применимо, подрядчики и субподрядчики организации соблюдали те же кодексы практики и политики.

Эти меры дают возможность любой заинтересованной стороне выявлять и сообщать о несоответствующем поведении системы ИИ и получать конструктивные и адекватные ответы. Они особенно важны там, где задействованы сложные цепочки поставок и где репутационный, финансовый или иные риски могут быть возложены на ведущего подрядчика или закупщика. Организации следует получить четкое представление о последствиях использования ИИ в рамках договорных отношений, в которых задействованы риск-аппетиты различных организаций.

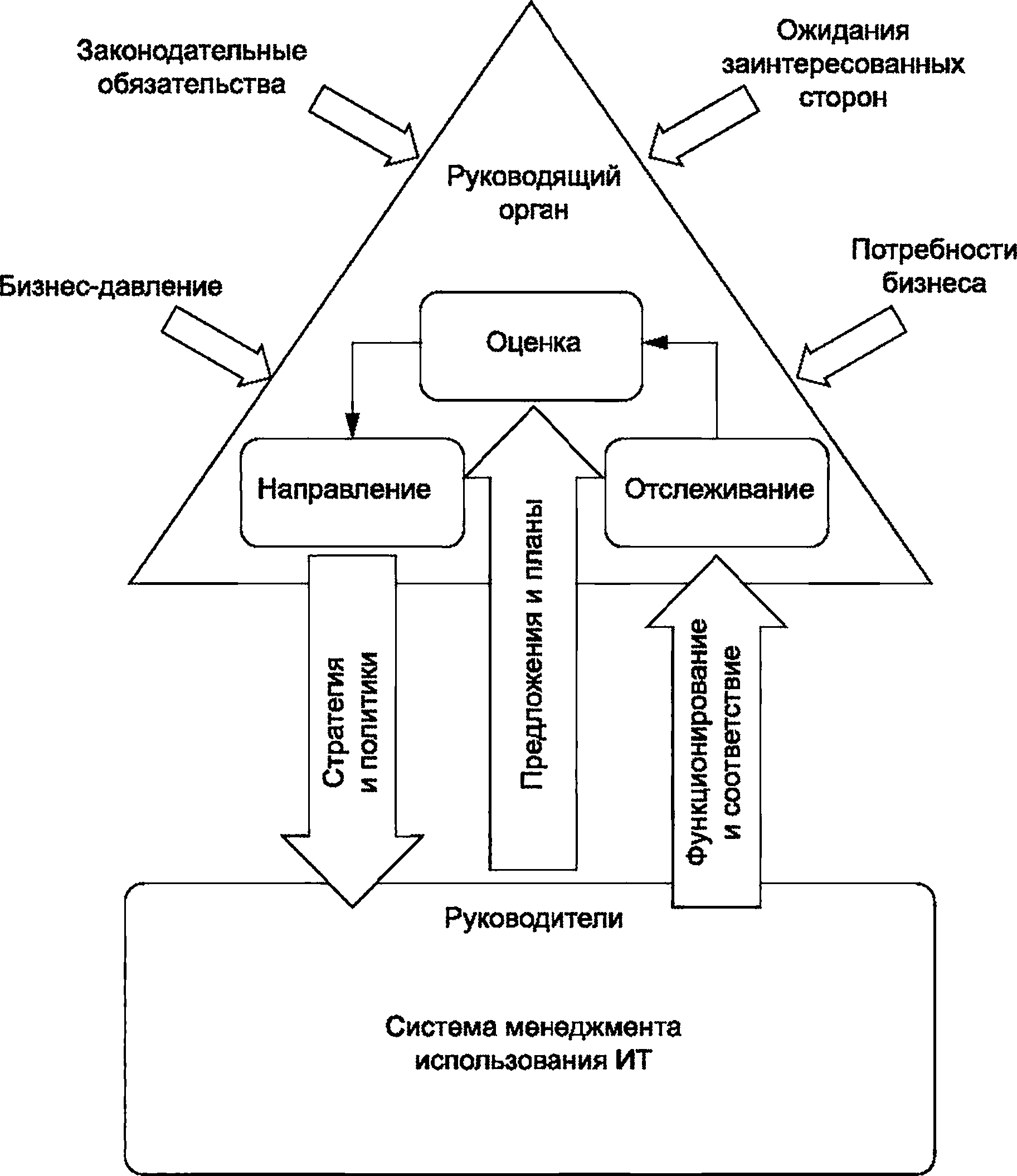

На рисунке 4 продемонстрированы следующие примеры:

- цели, которые преследует организация (например, защита репутации);

- дополнительные источники риска, которые может привнести в организацию использование ИИ;

- некоторые технические и организационные средства управления, которые могут быть использованы для устранения рисков.

|

Рисунок 4 - Управление рисками при использовании ИИ

6.7.3 Цели

Цели, которые организация намерена защитить с помощью процессов управления рисками, включают в себя не только защиту активов, таких как данные, информационные системы, код приложений, алгоритмы и оборудование, но и ее обязанности по соблюдению культуры и надлежащих ценностей, с учетом репутационных рисков и стратегических задач.

На рисунке 4 показаны примеры целей, которые ставит организация:

- подотчетность и ответственность. Руководящему органу следует поддерживать подотчетность, а также надзор за выполнением организацией своих обязанностей как внутри, так и за пределами организации в отношении использования ИИ;

- репутация и доверие. Рассматриваемый риск относится непосредственно к организации. Однако организация не существует изолированно, поэтому должны быть рассмотрены ее заинтересованные стороны и та среда, в которой она работает. Необходимо, чтобы последствия и вероятность рисков, влияющих на заинтересованные стороны, такие как клиенты и поставщики, были ключевыми соображениями с точки зрения риска для организации;

- обязанность проявлять заботу. Организация несет ответственность и, возможно, законодательную обязанность в отношении своих заинтересованных сторон, как внутренних, так и внешних. Это может включать обязательство (с нормативными или правовыми последствиями, в зависимости от юрисдикции) обеспечить благополучие всех заинтересованных сторон и защиту их прав, например доступ к значимым финансовым, медицинским или жилищным услугам, а также прав человека (включая свободу передвижения или неприкосновенность частной жизни);

- в ситуациях, когда существует значительный риск, связанный с обязанностью проявлять заботу, руководящему органу следует потребовать дополнительные организационные средства управления для результативного отношения к таким рискам и обеспечения того, чтобы они не превышали риск-аппетит организации (примеры см. в 6.7.5);

- безопасность. В тех случаях, когда использование системы ИИ сопряжено со значительным риском причинения физического или эмоционального вреда, организации следует быть предельно внимательной к характеру и последствиям такого вреда. При необходимости организации следует внедрить соответствующие системы для постоянного управления безопасностью, а также рассмотреть вопрос о том, как использование ИИ может снизить подверженность людей рискованным видам деятельности;

- безопасность и конфиденциальность. Организации следует обеспечивать безопасность своей операционной деятельности, особенно в тех случаях, когда необходима конфиденциальность и важна неприкосновенность частной жизни. Эти цели не следует менять при использовании ИИ, особенно учитывая способность систем ИИ производить новую информацию из закономерностей в данных;

- данные. Данные являются значительным ресурсом для организации, и их защита и целостность должны быть целью организации;

- прозрачность. Прозрачность принятия решений организацией, вероятно, будет целью, которую руководящий орган предпочитает поддерживать. Заинтересованные стороны ожидают понимания хотя бы некоторых важных исходных данных и переменных, которые объясняют, как организация принимает решения. Это происходит независимо от того, насколько автоматизировано принимается решение;

- некоторые из этих целей подробно изложены в [20], [17], а также в [6].

6.7.4 Источники риска

Организации следует ожидать появления дополнительных источников риска в зависимости от масштаба и характера той области, в которой применяют систему ИИ, и типа развернутой системы ИИ. Некоторые виды использования ИИ будут ограничиваться и контролироваться, что приведет к незначительному риску или к отсутствию дополнительного риска для организации. Другие виды использования будут нести значительные риски, которых раньше в организации не было.

Кроме того, с одной стороны, менее зрелые технологии, например используемые при разработке и применении систем ИИ, могут создавать риски, которые неизвестны организации или их сложно оценить (см. [3]). С другой стороны, для зрелых технологий может быть доступно большее разнообразие данных об опыте, что облегчает выявление и оценку рисков. Набор уровней готовности, характеризующих зрелость системы ИИ, может быть полезен для оценивания и отслеживания рисков.

Прямое сопоставление активов, ценностей и целей с источниками риска или средствами управления рисками невозможно, поскольку влияние любого из этих элементов может быть распространено на другой элемент.

Примеры источников риска, показанные на рисунке 4, относятся к использованию ИИ, хотя эти источники могут быть применимы и ко многим другим технологиям или процессам. Организации следует ожидать появления дополнительных источников риска в зависимости от масштаба и характера используемых систем ИИ. Приведенные примеры включают:

- поиск источников данных. Поскольку данные используют для построения и обучения модели в системе МО, качество и адекватность данных имеют решающее значение, и им следует соответствовать предполагаемому использованию и целям системы. Данные, подвергнутые манипуляциям, могут допустить состязательные атаки, что приведет к "отравлению" модели и неправильной классификации;

- неясные условия. При традиционной разработке программного обеспечения характер задачи и ее решение тесно связаны, поскольку люди, вовлеченные в процесс, используют схожие подходы для решения обеих задач. Однако система ИИ может прийти к решению совершенно другим способом спустя долгое время после того, как система была первоначально спроектирована и разработана, поэтому точность, ясность и объем условий задачи, системные требования, цели системы и границы поведения могут иметь большое значение;

- цепочку создания ценности. Поставка и распространение систем ИИ может включать риски так же, как и использование систем ИИ теми, кто находится за пределами организации. Необходимо, чтобы подотчетность была четко определена и согласована между различными сторонами в цепочке создания ценности;

- нежелательную предвзятость. Алгоритм, обучающие и тестовые данные, а также модель МО, используемые в системах ИИ, часто нацелены на отражение и прогнозирование ситуаций реального мира. По своей природе эти системы представляют собой лишь небольшую выборку или перспективу и могут давать результаты, которые отражают выборку, а не реальный мир. Это может привести к усилению нежелательной предвзятости (см. [5]);

- отсутствие объяснимости МО. Риск возникает из-за сложности систем ИИ. Это может сделать предельно затруднительным объяснение того, как система ИИ пришла к определенному выводу и отличаться от традиционных систем ИТ, где человек определяет алгоритмическую процедуру для определения ответа. Человека можно опросить, перепроверить, оценить его положение и репутацию, привлечь к ответственности и протестировать любой код, чтобы убедиться в том, что он дал прогнозированные ответы;

- отсутствие опыта в области ИИ. Использование ИИ требует навыков, отличных от традиционной разработки программного обеспечения, хотя эти навыки также необходимы. Дополнительные навыки включают в себя понимание аналитики данных и статистики, моделирования, разработки и тестирования алгоритмов, а также определенных навыков работы с людьми, таких как этика и эмпатия;

- киберугрозы. Внедрение некоторых систем ИИ может быть уязвимо для отдельных и трудно распознаваемых киберугроз, которые оставляют после себя малозаметные следы или вообще их не оставляют;

- другие источники риска связаны с использованием ИИ и его косвенным воздействием на человека, например:

- утрата навыков. Все более широкое использование ИИ в рутинных ролях по принятию решений означает, что люди со временем все меньше подвергаются воздействию опыта. Сокращение опыта сотрудников ("атрофия агентов") лишает человека возможности совершенствовать свои навыки, способности принимать решения и опыт. Такое вытеснение развития человеческих навыков представляет собой риск для организаций в частности и общества в целом,

- договорные вопросы. Руководящему органу следует обеспечить то, чтобы применимые договоры, законы и передовая практика оставались в силе при использовании систем ИИ. Во многих приложениях системы ИИ учатся на основе данных и практики принимающей их организации, на начальном и потенциально постоянном уровне. Это уникальным образом делает системы ИИ отражением организации, которую они обслуживают, что может повлиять на применимость договоров, законов и передовой практики,

- экологические вопросы. Руководящему органу следует рассмотреть риск выбросов углекислого газа в результате потребления энергии для обучения ИИ и обработки данных. Ему также следует учитывать риск загрязнения окружающей среды и истощения ресурсов из-за ускоренного устаревания аппаратного обеспечения в пользу более новых облачных и периферийных устройств с поддержкой ИИ,

- личная автономия. Использование ИИ все чаще может определять диапазон выбора, с которым сталкиваются люди в плане новостей, развлечений, взаимодействий, продуктов и услуг. Несмотря на то что по отдельности эти решения незначительны, растущая частота и повсеместное распространение этих решений означает, что руководящему органу следует рассмотреть влияние использования ИИ на автономию человека как личности, так и в составе сообщества,

- упущенные возможности. Руководящие органы иногда слишком консервативны, чтобы воспользоваться новыми возможностями. Если руководящий орган не использует возможности, которые раскрывает возможность использования ИИ, организация может столкнуться с усилением конкуренции со стороны тех организаций, которые используют такие возможности.

6.7.5 Средства управления